EU AI-ACT – Verordnung

Der EU AI-ACT – was Unternehmen ab jetzt beachten müssen

ACHTUNG: Dieser Artikel stellt keine Beratung in Form einer rechtlichen Beratung dar, sondern ist ausschließlich als Wissenstransfer zu verstehen.

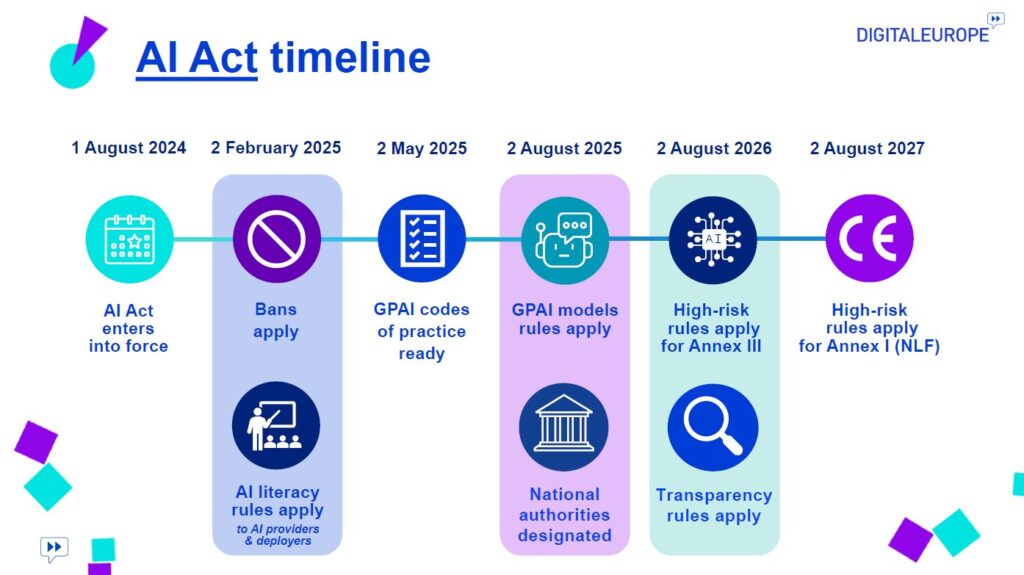

Die Regulierung von KI ist wichtig, denn sie dient zum Schutz der Menschheit bei der Nutzung der Technologie. Für Bürger, Arbeitnehmer und im speziellen Unternehmen mit deren Softwareentwicklern in der europäischen Union, gelten darum seit dem 02. Februar 2025 die neuen Regeln. Wir haben hier eine AI Act Zusammenfassung vorbereitet, was das inkrafttreten der Ki Verordnung bedeutet.

KI Verordnung aktueller Stand:

Quelle: DigitalEurope

Was genau besagen die neuen Regeln?

Für alle Firmen, welche KI im Einsatz haben gelten ab Februar 2025 die neuen Regeln zu Verbotenen KI-Praktiken sowie zur KI-Kompetenz.

Verbotene KI-Praktiken: Bestimmte Anwendungen von Künstlicher Intelligenz, die als unannehmbares Risiko eingestuft werden, sind nun innerhalb der EU verboten. Dazu zählen beispielsweise Systeme, die Menschen manipulieren oder ausbeuten, Social Scoring betreiben oder in bestimmten Bereichen Emotionserkennung einsetzen.

AI Literacy (KI-Kompetenz): Anbieter und Betreiber von KI-Systemen sind verpflichtet, sicherzustellen, dass ihr Personal über ausreichende Kenntnisse und ein Verständnis für KI verfügt. Dies umfasst das Bewusstsein für Chancen und Risiken von KI sowie die Fähigkeit, diese Technologien effektiv und verantwortungsvoll einzusetzen.

Quelle: https://www.wsgr.com/en/insights/the-eus-ai-act-starts-to-apply-as-of-february-2-2025.html

Triff Manuel – Dein Experte für KI bei Owlytic!

Gemeinsam können wir Dein Unternehmen auf das nächste Level bringen.

Telefon: +49 7264 2080054

E-Mail: manuel.fischer@owlytic.com

Compliance Sommer 2025 und 2026

Ab dem Sommer 2025 müssen außerdem GPAI und ab 2026 die Risikokategorisierung nach Anhang 3 sowie die Transparanzpflicht eingehalten werden. Wir haben nachfolgend einige wichtige Themen in der AI Act Zusammenfassung.

Wie komme ich in die Anwendung des EU AI-ACT?

Der erste Schritt ist es herauszufinden, ob deine Anwendung eine KI System nach Art.3 des EU AI-Act ist. Der Artikel 3 des EU AI Act ist essenziell, um zu bestimmen, ob der EU AI-Act Anwendung findet. Der Artikel definiert zentrale Begriffe wie „KI-System“, „Anbieter“, „Bereitsteller“, „Benutzer“ und „Hochrisiko-KI“, die für die Anwendung des Gesetzes maßgeblich sind.

Warum ist Artikel 3 relevant für die Anwendung des AI Act?

- Definition von KI-Systemen

- Der Artikel legt fest, was als KI-System gilt.

- Wenn eine Technologie nicht unter diese Definition fällt, unterliegt sie nicht dem AI Act.

- Abgrenzung der Akteure

- Der Artikel unterscheidet zwischen Anbietern (Developers), Bereitstellern (Distributoren) und Nutzern (End-User).

- Wer als „Anbieter“ gilt, hat umfangreichere Pflichten, insbesondere bei Hochrisiko-KI.

- Risiko-Klassifizierung

- Der AI Act basiert auf einer risikobasierten Regulierung.

- Artikel 3 enthält Definitionen, die zur Einstufung in Minimal-, Gering-, Hoch- oder Systemisches Risikobeitragen.

Eine Übersicht wie die Risikoeinstufung zu verstehen ist und welche Artikel innerhalb des European AI-Act relevant zu jeder Risikokategorie sind:

|

Requirements & Obligations |

High-risk (Art. 6) e.g. HR Systems and MedTech |

Limited risk (Art. 50) e.g. Chat Bots |

Minimal risk (default) e.g. Games |

Systemic risk GPAI (Art. 51) e.g. Hyperscalers (GPT, Gemini) |

Basic risk GPAI (default) e.g. Midjourney |

|

AI literacy for providers and deployers (Art. 4) |

x |

x |

x |

x |

x |

|

Data governance, data quality, privacy, fairness (Art. 10) |

x |

x |

|||

|

Technical documentation for regulators (Art. 11, Ann. IV, XI) |

x |

x |

|||

|

Monitoring, logging, and incident reporting (Art. 12) |

x |

x |

|||

|

Transparency obligations and user instructions (Art. 13, 50) |

x |

x |

x |

||

|

Human oversight (Art. 14, 26) |

x |

x |

|||

|

Accuracy, robustness and cybersecurity (Art. 15) |

x |

x |

|||

|

Lifecycle risk (Art. 9) and quality management (Art. 17) |

x |

x |

|||

|

Fundamental rights impact assessment (Art. 27) |

x |

x |

|||

|

Conformity assessment (Art. 43) & corrective actions (Art. 20) |

x |

x |

|||

|

Public EU database registration (Art. 49, 52, Ann. VIII) |

x |

x |

|||

|

Data protection, intellectual property protection (Art. 53) |

x |

x |

|||

|

GPAI model evaluation and adversarial testing (Art. 55) |

x |

||||

|

GPAI code of practice application without hEN (Art. 56) |

x |

Eine Besonderheit kommt hier den GPAI (General Purpose Artificial Intelligence) Modellen zu. Hier wird ebenfalls nach Hersteller und Anwender unterschieden, was zu Unterschieden in den Pflichten führt. Unabhängig von den Ergebnissen aus Art. 3 sollten sie prüfen welche Anforderungen auf Basis des GPAI für sie relevant sind.

- Verpflichtungen für Hersteller von GPAI

Hersteller von GPAI-Modellen (z. B. OpenAI für GPT-4 oder Google für Gemini) müssen:

- Technische Dokumentation bereitstellen (Art. 11)

- Risikomanagement durchführen (Art. 9)

- Transparenzpflichten erfüllen (Art. 13, 50)

- GPAI-Modellbewertung und adversariales Testen durchführen (Art. 55)

- Registrierung in der EU-Datenbank (Art. 49, 52)

- Verpflichtungen für Anwender von GPAI

Auch Anwender von GPAI (z. B. Unternehmen, die KI-gestützte Tools in ihren Produkten oder Dienstleistungen nutzen) haben bestimmte Verantwortlichkeiten, insbesondere wenn sie ein Modell in ein Hochrisiko-KI-System integrieren oder es in einem sensiblen Bereich einsetzen.

Mögliche Pflichten für Anwender:

- Transparenzpflichten, wenn sie KI-generierte Inhalte bereitstellen

- Sorgfaltspflichten, falls die GPAI für personalisierte oder automatisierte Entscheidungen genutzt wird

- Einhaltung von Datenschutz- und Sicherheitsvorgaben, insbesondere in regulierten Branchen

Fazit:

Nicht nur Hersteller, sondern auch Anwender von GPAI müssen bestimmte Regeln einhalten – vor allem, wenn sie diese Technologien in sensiblen Bereichen nutzen oder weiterverarbeiten.

Sie möchten eine Einstufung nach dem EU AI-Act vornehmen? Dann kontaktieren Sie uns jetzt um unser Tool zur Risikobewertung zu nutzen.